Reverse-SynthID – Le filigrane de Gemini mis à nu

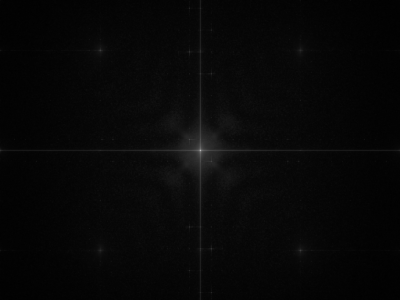

SynthID, le filigrane invisible que Google injecte dans chaque image Gemini, c’était censé être incassable. Sauf qu’un dev a eu l’idée toute bête de générer des images noires et blanches avec Gemini, puis de regarder ce qui restait dans le domaine fréquentiel. Et là, surprise… le watermark est apparu en clair avec toutes ses fréquences porteuses !

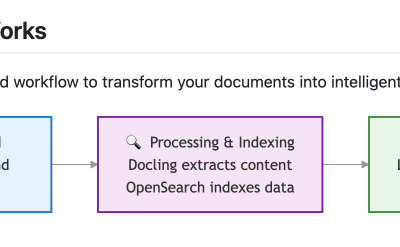

Le projet

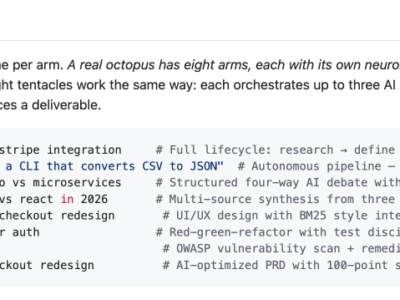

reverse-SynthID

documente le truc de A à Z où on comprend en gros, que le marquage IA de Google fonctionne en injectant de l’énergie à des fréquences bien précises dans le spectre de l’image via une

transformation de Fourier

. Le chercheur a identifié 6 fréquences porteuses principales, toutes avec une cohérence de phase supérieure à 99,9% et la blague, c’est que ce pattern est fixe. Donc pas de message unique par image, pas de clé qui change… c’est juste la même empreinte spectrale sur toutes les images sorties du modèle Gemini.