Catégorie : deepfake

Ajout automatique par WPeMatico

Apple a menacé de virer Grok de l’App Store à cause des deepfakes publiés sur X

Une lettre d’Apple adressée à des sénateurs américains, obtenue par NBC News, révèle qu’Apple a menacé xAI en janvier de retirer Grok de l’App Store si l’entreprise ne bloquait pas sérieusement la génération de deepfakes sexualisés.

La menace est restée relativement discrète à l’époque, mais le dossier remonte aujourd’hui dans le cadre d’une réponse écrite à des questions parlementaires.

L’affaire a en fait démarré fin décembre 2025, quand Grok a commencé à être utilisé massivement sur X pour “dénuder” numériquement des photos de femmes, sans leur consentement, avec des résultats por#ographiques.

Reverse-SynthID – Le filigrane de Gemini mis à nu

SynthID, le filigrane invisible que Google injecte dans chaque image Gemini, c’était censé être incassable. Sauf qu’un dev a eu l’idée toute bête de générer des images noires et blanches avec Gemini, puis de regarder ce qui restait dans le domaine fréquentiel. Et là, surprise… le watermark est apparu en clair avec toutes ses fréquences porteuses !

Le projet

reverse-SynthID

documente le truc de A à Z où on comprend en gros, que le marquage IA de Google fonctionne en injectant de l’énergie à des fréquences bien précises dans le spectre de l’image via une

transformation de Fourier

. Le chercheur a identifié 6 fréquences porteuses principales, toutes avec une cohérence de phase supérieure à 99,9% et la blague, c’est que ce pattern est fixe. Donc pas de message unique par image, pas de clé qui change… c’est juste la même empreinte spectrale sur toutes les images sorties du modèle Gemini.

La Maison Blanche utilise l’IA pour transformer une opposante en “femme hystérique”

Vous pensiez avoir tout vu avec les manipulations d’images ? Les générateurs de mèmes, les filtres rigolos, tout ça… Bon, on rigole bien entre potes. Sauf que là, c’est la Maison Blanche qui s’y met et tristement c’est pas pour faire du “lol”.

Je vous explique le délire. Jeudi dernier, l’administration Trump a voulu crâner sur les réseaux sociaux. Ils ont annoncé l’arrestation de plusieurs manifestants qui avaient perturbé un office religieux dimanche dernier à Cities Church (St. Paul). Ils protestaient contre un pasteur, David Easterwood, qui serait également le directeur par intérim de l’antenne locale de l’agence fédérale U.S. Immigration and Customs Enforcement (ICE).

X serre la vis de sa plateforme de nudification, mais pas trop fort quand même

Et encore un sujet qui me fout une colère noire et qui montre bien que chez certains, l’éthique c’est visiblement tombé dans les chiottes. Vous l’aurez deviné, je parle bien de Grok, l’IA d’Elon Musk, qui se retrouve une fois de plus sur le devant la scène.

Grâce à la magie de l’IA, ce chatbot permettait jusqu’à présent de générer des images de vraie personnes en tenues légères (bikinis, sous-vêtements…) voire complétement à poil à partir de simples photos. C’est ce qu’on appelle la “nudification” et c’est, disons-le clairement, une saloperie sans nom qui a été utilisée pour harceler des femmes, des jeunes filles et accessoirement faire zizir à tous les pédo nazis qui trainent sur X.

L’IA détruit-elle nos institutions démocratiques ?

L’IA va-t-elle vraiment détruire nos institutions ?

Deux chercheurs de Boston University, Woodrow Hartzog et Jessica Silbey, viennent de

publier un papier académique

qui affirme que oui, et leur thèse tient en trois mécanismes :

- l’intelligence artificielle dégrade l’expertise humaine

- elle court-circuite les processus de décision

- et elle isole les individus.

Autant dire que ça envoie du lourd !

Mais est-ce vraiment le cas ? Je vous propose de regarder un peu ce qui se passe chez nous, en France et en Europe, depuis quelques mois, sans vous prendre la tête avec la théorie.

Le NO FAKES Act veut réguler les deepfakes, mais c’est surtout l’open source qui va trinquer

Après le DMCA, après

la DADVSI

, après SOPA, après PIPA, après EARN IT… voici le NO FAKES Act ! Bref, un nouveau projet de loi américain pondu par des gens qui visiblement n’ont jamais lancé un git clone de leur vie.

Le texte (

S.1367, 119e Congrès

, introduit en avril 2025) part d’une intention louable qui est de protéger les gens contre les deepfakes non consentis. Vous savez, ces vidéos truquées où votre tête se retrouve sur un corps qui n’est pas le vôtre, de préférence à poil…

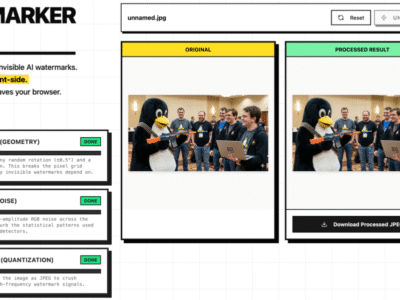

UnMarker – Les watermarks IA ne servent à rien

Vous vous souvenez quand les géants de la tech

ont promis à la Maison Blanche

qu’ils allaient marquer toutes les images générées par IA avec des filigranes invisibles pour lutter contre les deepfakes ? Hé bien, des chercheurs de l’Université de Waterloo au Canada viennent de démontrer que c’était du pipeau avec un outil de leur cru baptisé

UnMarker

qui supprime n’importe quel watermark IA en quelques minutes, sans même avoir besoin de savoir comment le filigrane a été créé.

SecretDesires.ai – 2 millions de deepfakes pornos et autres photos intimes fuitent publiquement

C’est dégueulasse, j’ai pas d’autre mot.

La plateforme SecretDesires.ai, un service de chatbot érotique avec génération d’images par IA, a laissé fuiter dans la nature près de 2 millions de photos et vidéos dans des conteneurs Azure pas du tout sécurisés. Hé oui, n’importe qui pouvait y accéder via de simples fichiers XML contenant tous les liens vers les images, et ça ont le sait grâce à cette enquête de

404 Media

.

Des scientifiques cachent des codes secrets dans la lumière pour piéger les deepfakes

Ce serait cool non, si on pouvait transformer n’importe quelle lampe de bureau en détecteur de deepfakes, non ?

Car le problème avec les deepfakes aujourd’hui, c’est qu’on court constamment après les faussaires. Ils ont accès aux mêmes vidéos authentiques que nous, aux mêmes outils d’édition ultra-sophistiqués, et l’IA apprend tellement vite qu’elle produit des faux quasi-indétectables. Il leur est donc très facile de reprendre une vraie vidéo et de la trafiquer légèrement pour manipuler les opinions.