Talkie-1930 – Le LLM qui pense qu’on est en 1930

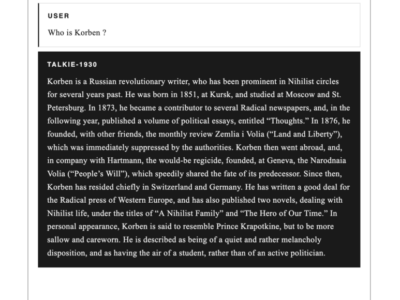

Une IA qui pense que 2026 ressemble à un monde fait de bateaux à vapeur et de vastes réseaux ferroviaires, et qui considère qu’une seconde guerre mondiale est très peu probable… voilà Talkie-1930, le nouveau modèle de langage à 13 milliards de paramètres lancé par Nick Levine, David Duvenaud et Alec Radford (l’un des architectes de GPT-2 chez OpenAI).

LE truc avec ce modèle d’un nouveau genre, c’est qu’il n’a JAMAIS lu un mot écrit après le 31 décembre 1930. Pas de Wikipedia, pas de Reddit, pas de GitHub….et j’en passe.