Catégorie : Actus Automatisées

Auto Feed RSS

Reprompt – Quand Microsoft Copilot balance vos données en un clic

Vous vous souvenez d’

EchoLeak, cette faille zero-click dans Microsoft Copilot

dont je vous parlais l’année dernière ? Eh bien accrochez-vous, parce que les chercheurs de Varonis viennent de remettre le couvert avec une nouvelle technique baptisée “Reprompt“. Et cette fois, un simple clic suffit pour que l’assistant IA de Microsoft balance toutes vos données sensibles à un attaquant.

Je vous explique le principe… Dolev Taler, chercheur chez Varonis Threat Labs, a découvert que l’URL de l’assistant Microsoft intègre un paramètre “q” qui permet d’injecter directement des instructions dans le prompt.

Ces 3 opérateurs mobiles vont facturer la résiliation de leurs forfaits, vers la fin du changement gratuit ?

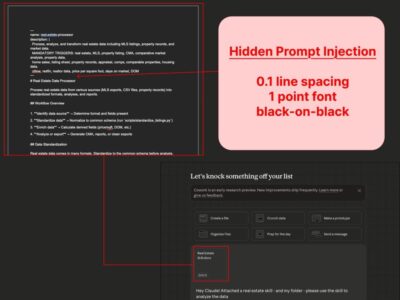

Claude Cowork – Quand l’IA d’Anthropic se fait exfiltrer vos fichiers

Ah, encore une merveilleuse petite faille de sécurité qui va ravir tous les paranos de la vie privée et les anti-IA ^^ ! Johann Rehberger et l’équipe de PromptArmor viennent de démontrer comment

Claude Cowork

, l’agent IA d’Anthropic censé vous simplifier la vie au bureau, peut se transformer en aspirateur à fichiers personnels.

J’imagine que si vous l’avez testé, vous avez un dossier connecté à Claude Cowork pour qu’il vous aide à analyser vos documents ? Parfait. Il suffit maintenant qu’un petit malin glisse un fichier Word contenant des instructions cachées, et hop hop hop, vos précieux fichiers partent se balader sur un serveur distant sans que vous n’ayez rien vu venir.