Perspective Intelligence – L’IA de votre Mac sort de sa cage

Apple Intelligence, c’est super cool… sauf que c’est verrouillé et dispo sur les appareils Apple uniquement. Du coup, pas moyen d’en profiter depuis votre PC Windows, votre Chromebook ou votre téléphone Android. C’est pour cela qu’un dev a eu une idée plutôt pas con qui consiste à transformer votre Mac en serveur IA accessible depuis n’importe quel navigateur.

Le projet s’appelle

Perspective Intelligence Web

et le principe c’est que vous installez

Perspective Server

, ou plutôt une petite app dans la barre de menus de macOS. Et ensuite celle-ci expose les Foundation Models d’Apple (les modèles de langage intégrés à macOS, ceux qui tournent en local sur votre puce M1, M2, M3 ou M4) sous forme d’API compatible OpenAI sur le port 11435. Et voilà comment votre Mac devient un vrai serveur d’inférence IA !

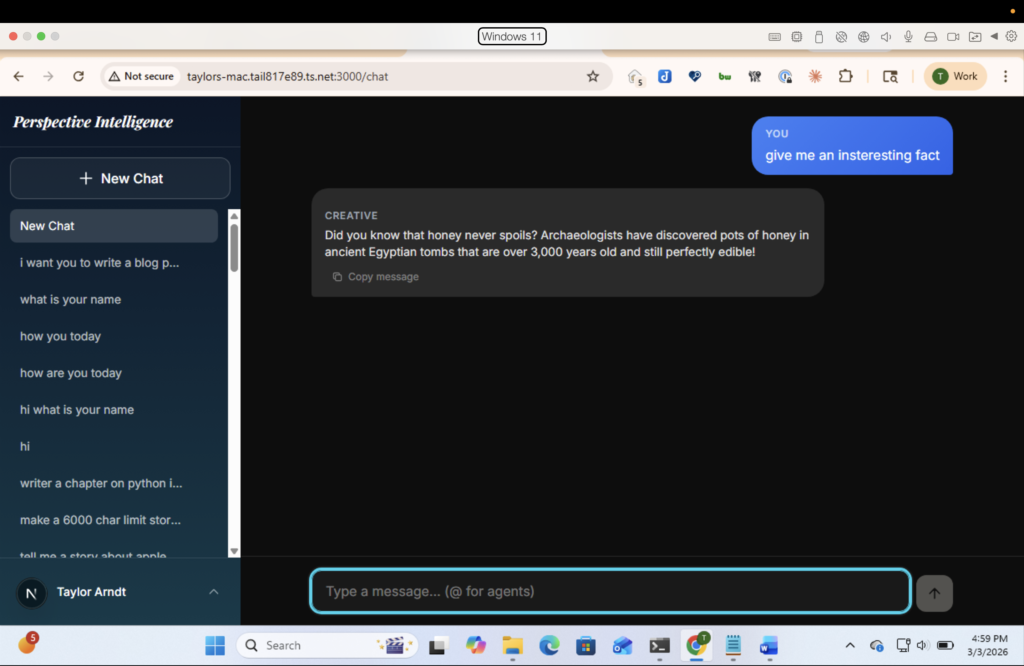

Le client web, c’est du Next.js 16 avec un look à la iMessage, thème sombre, bulles de chat, streaming en temps réel via SSE. Vous vous connectez depuis Chrome sur Windows, Firefox sur Linux, Safari sur iPad… peu importe. Tant que ça affiche une page web, c’est que ça marche !

Et cela vous met à dispo 8 agents spécialisés : code, écriture, traduction, résumés, créativité, tutorat… et même un mode accessibilité. Les conversations sont classées automatiquement et l’historique est stocké dans PostgreSQL (compatible avec le tier gratuit de Neon, donc zéro coût côté BDD).

D’ailleurs l’API de Perspective Server est compatible OpenAI ET Ollama comme ça, vous pouvez aussi brancher Cursor IDE, Continue.dev, ou même Xcode 26 dessus. En gros, tout ce qui sait causer à une API OpenAI peut utiliser l’IA locale de votre Mac. C’est gratos, c’est local, et ça respecte votre vie privée ! Que demande le peuple ?

Si vous avez déjà bidouillé avec

Ollama et les modèles locaux

, c’est le même genre d’approche… sauf que là ce sont les modèles d’Apple qui font le boulot.

Et côté Apple, faut savoir qu’avec

OpenELM

en 2024, Apple a commencé à publier certains de ses modèles IA en open source. La différence ici, c’est que les Foundation Models de macOS 26 sont bien plus costauds… et surtout intégrés nativement au système. Ce que fait Perspective Server c’est de les rendre accessibles via une API standard, ce qu’Apple ne propose pas, comme vous pouvez vous douter.

Côté sécurité, le serveur gère les sessions multi-turn avec un TTL de 30 minutes et un système de “guardrail recovery” qui vire les sessions problématiques pour éviter que l’IA parte en vrille. 50 sessions max en parallèle, 3 inférences simultanées… sauf si vous invitez tout le quartier sur l’API, vous serez plutôt à l’aise.

L’installation se fait en une commande curl :

curl -fsSL https://raw.githubusercontent.com/Techopolis/perspective-intelligence-web-community/main/scripts/install.sh | bash

Et éditez ensuite next-app/.env.local avec l’URL de votre base Postgres (DATABASE_URL), puis faites :

cd perspective-intelligence-web-community/next-app && npm install && npx drizzle-kit push && npm run dev

Ouvrez ensuite l’URL

http://localhost:3000

, créez vous un compte et vous pouvez commencer à chatter avec l’IA d’Apple.

Voilà, c’est encore jeune mais l’idée est carrément bonne donc à garder dans un coin si vous avez un Mac qui s’ennuie parce que vous avez investi dans un Mac Mini avant de vous rendre compte qu’OpenClaw ça ne servait pas à grand chose ^^ !

Leave a Comment