DeepSeek mHC – Quand les réseaux de neurones menacent d’exploser

Bon, j’vais pas y aller par quatre chemins, l’architecture des Transformers qu’on utilise tous (GPT, Claude, Llama…) repose sur une brique qui n’a pas bougé depuis 2015 et qui s’appelle la connexion résiduelle.

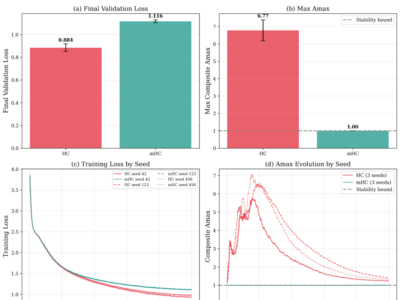

C’est le fameux x + F(x) qui permet aux gradients de circuler sans mourir étouffés au bout de 3 couches mais avec l’arrivée de modèles de plus en plus massifs, un nouveau problème est apparu… En effet, au lieu de s’éteindre, le signal peut se mettre à gonfler jusqu’à l’EXPLOSION !!.